Now Reading: Disney scarica OpenAI: Sora chiude e salta l’accordo da 1 miliardo

-

01

Disney scarica OpenAI: Sora chiude e salta l’accordo da 1 miliardo

Disney scarica OpenAI: Sora chiude e salta l’accordo da 1 miliardo

OpenAI chiude Sora e Disney si ritira: salta l’accordo da 1 miliardo. Dietro la scelta, dati, copyright e la vera guerra tra AI e Hollywood.

OpenAI chiude Sora, la sua piattaforma di generazione video basata su intelligenza artificiale generativa, e con essa salta uno degli accordi più ambiziosi tra Big Tech e Hollywood. Disney si sfila dall’intesa, cancella l’investimento da 1 miliardo di dollari e chiude una collaborazione che fino a pochi mesi fa veniva raccontata come l’inizio di una nuova era per l’intrattenimento.

Un progetto nato grande e finito troppo in fretta

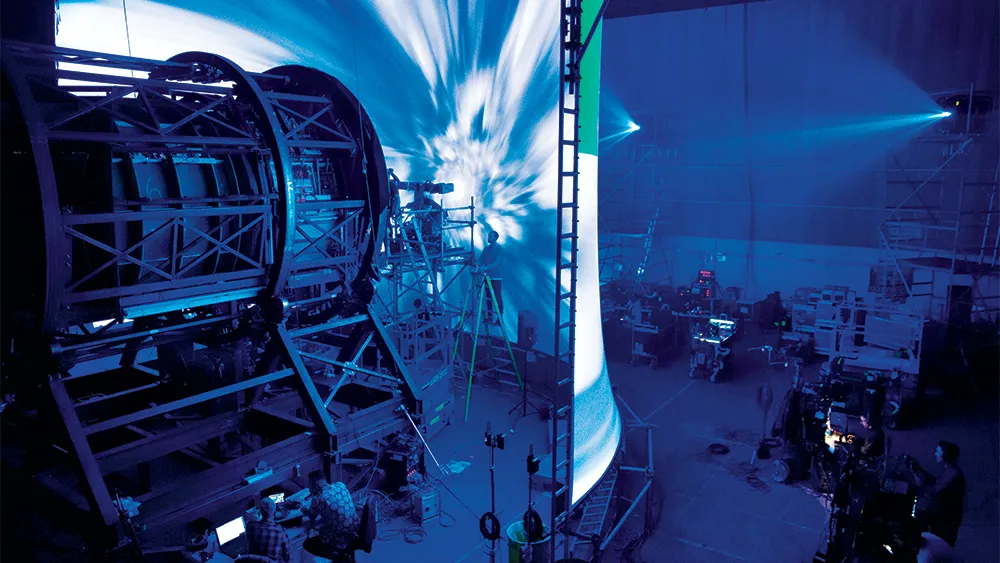

Sora era stata presentata come uno dei prodotti più impressionanti dell’ondata di AI generativa: video realistici, personaggi credibili, possibilità di trasformare idee in sequenze visive con una semplicità mai vista prima. Hollywood aveva reagito con un misto di entusiasmo e paura, soprattutto quando OpenAI aveva adottato un modello “opt-out” che di fatto permetteva l’utilizzo di contenuti protetti salvo esplicita opposizione dei detentori dei diritti.

Le proteste non si erano fatte attendere. Studi, associazioni e produttori avevano iniziato a muoversi legalmente, costringendo OpenAI a rivedere parte delle sue politiche. Il problema, però, non era solo giuridico: era strutturale. Sora non era semplicemente uno strumento creativo, ma un sistema che metteva in discussione il controllo stesso della produzione audiovisiva.

Non a caso, proprio mentre OpenAI cercava di correggere il tiro, il progetto ha iniziato a perdere coerenza strategica. L’azienda guidata da Sam Altman non ha abbandonato il video AI, ma ha deciso di sacrificare l’app standalone, segno che il modello non stava funzionando come previsto.

Disney si ritira: troppo rischio, poco controllo

L’accordo con Disney prevedeva qualcosa di molto concreto: integrazione dei personaggi più iconici – da Marvel a Star Wars – dentro Sora, con la possibilità per gli utenti di generare contenuti “ispirati” direttamente nell’ecosistema Disney+. In cambio, OpenAI avrebbe ottenuto licenze strategiche e un investimento da 1 miliardo di dollari.

Oggi quell’accordo non esiste più. Nessun trasferimento di denaro, nessuna integrazione, nessuna roadmap condivisa. Ufficialmente, Disney parla di “rispetto per le nuove priorità di OpenAI” e di volontà di continuare a esplorare l’AI in modo responsabile. Tradotto: il rischio reputazionale e legale era troppo alto, mentre il controllo sull’utilizzo dei contenuti troppo basso.

Non è un dettaglio secondario. Negli ultimi mesi Disney ha avviato azioni legali o inviato diffide a diverse aziende – da Google a Meta, fino a startup come Midjourney – accusate di utilizzare proprietà intellettuale senza autorizzazione. In questo contesto, continuare a investire in una piattaforma come Sora avrebbe significato alimentare lo stesso problema che l’azienda sta cercando di combattere.

Il vero segnale: la guerra sull’AI non è tecnologica, è industriale

La chiusura di Sora non è solo il fallimento di un prodotto, ma il segnale di un conflitto più ampio. Da una parte le aziende AI che spingono per modelli sempre più potenti e aperti, dall’altra le industrie dei contenuti che cercano di difendere controllo, diritti e modelli di business.

Nel mezzo, utenti e creator che vengono attratti da strumenti sempre più accessibili ma costruiti su fondamenta ancora fragili. Perché il punto non è se l’AI possa generare video realistici – ormai è evidente che può farlo – ma chi decide cosa può essere generato, con quali dati e a vantaggio di chi.

Con l’uscita di scena di OpenAI dal formato standalone, il campo resta in gran parte nelle mani di altri attori, con Google in posizione dominante sul fronte della generazione video su larga scala, ma già coinvolto in controversie simili legate al copyright.

Nel frattempo, Disney non ha cambiato direzione: continuerà a lavorare con l’intelligenza artificiale, ma alle proprie condizioni. Il messaggio è chiaro: l’AI è accettabile finché resta uno strumento sotto controllo, non quando diventa una piattaforma che ridefinisce le regole del gioco.

Questa vicenda ridimensiona anche la narrativa dominante degli ultimi mesi, quella che raccontava l’AI generativa come una rivoluzione inevitabile e lineare. Non lo è. È un terreno di scontro, dove tecnologia, potere economico e diritto si intrecciano in modo sempre più evidente.

Sora, più che un punto di arrivo, si rivela per quello che è stato davvero: un test.

In realtà il passaggio è piuttosto lineare, anche se viene raccontato come una retromarcia: OpenAI non ha abbandonato il video, ha semplicemente usato Sora come banco di prova su larga scala. Ha raccolto dati, osservato comportamenti, testato limiti tecnici e legali direttamente sul campo, senza il filtro delle simulazioni.

È un metodo sempre più diffuso: non si studia il mercato, lo si espone a un prodotto e si guarda come reagisce. Sora, in questo senso, non era il punto d’arrivo ma uno strumento per arrivarci più in fretta. Ora che le informazioni sono state raccolte, il prodotto può anche sparire: quello che serviva, ormai, è già stato assimilato.

E come spesso accade nei test, il risultato più interessante non è quello che funziona, ma quello che si rompe.