Now Reading: AI e complottismo: la fabbrica perfetta degli indizi

-

01

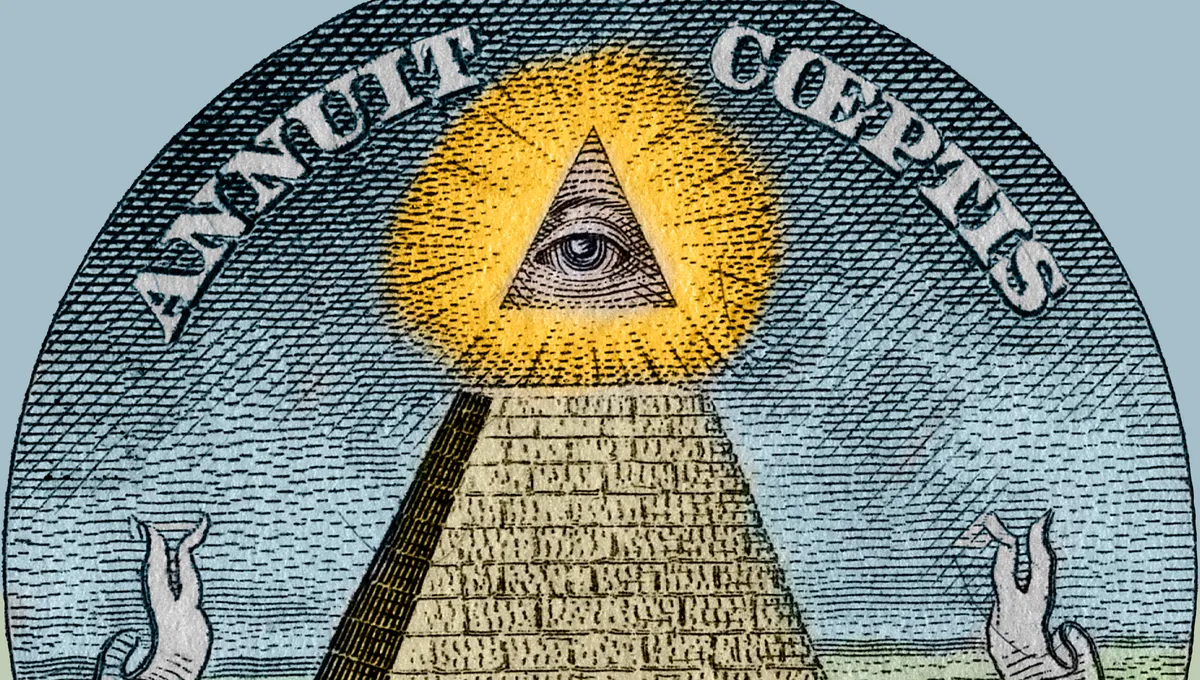

AI e complottismo: la fabbrica perfetta degli indizi

AI e complottismo: la fabbrica perfetta degli indizi

L’AI non inventa il complottismo, ma moltiplica indizi, falsi documenti e prove sintetiche. Ecco perché diventa la sua alleata perfetta.

L’intelligenza artificiale non inventa il complottismo. Gli mette il turbo. Perché prende ciò che queste narrazioni hanno sempre desiderato — indizi infiniti, connessioni apparenti, documenti suggestivi, voci autorevoli sintetiche, immagini “schiaccianti”, testi pseudo-investigativi — e lo rende scalabile, economico, personalizzabile.

In altre parole, se ieri il complottista doveva setacciare forum per settimane in cerca di materiale ambiguo, oggi può farselo quasi produrre su misura. La macchina non crea soltanto contenuti: crea disponibilità industriale di materiale interpretabile. È la fabbrica perfetta degli indizi.

L’AI abbassa il costo del sospetto organizzato

Con modelli generativi sempre più accessibili puoi creare immagini, video, voci, riassunti, timeline, mappe di relazioni, falsi leak, screenshot verosimili, documenti che “sembrano” tecnici, persino intere conversazioni fittizie. Non tutto sarà impeccabile. Ma, di nuovo, non serve. Deve solo essere abbastanza buono da alimentare la narrazione. Il complottismo non ha bisogno del certificato di autenticità: gli basta materiale abbastanza ambiguo da tenere viva la macchina interpretativa.

Il rischio, segnalato anche da standard setter e organismi che lavorano sul contenuto sintetico, è che detection e trasparenza restino sempre in affanno rispetto alla velocità di produzione. Per questo si parla sempre di più di provenance, credenziali, autenticazione e contesto del contenuto. Ma nessuna misura tecnica risolve il problema se l’ecosistema continua a premiare volume ed emozione.

Su Terza Pillola ne abbiamo già parlato in chiave più ampia, da come funzionano i modelli AI fino ai limiti dell’intelligenza artificiale. Qui la questione non è solo tecnica. È politica e culturale. Se puoi moltiplicare all’infinito materiali ambigui, allora puoi sommergere la verifica sotto una valanga di plausibilità.

Il complottismo ama l’AI perché l’AI ama i pattern

C’è poi un livello più sottile. L’AI generativa funziona per correlazioni, somiglianze, ricombinazioni, probabilità. Non “scopre” segreti: produce forme che ci sembrano coerenti. E questa coerenza statistica può essere scambiata molto facilmente per evidenza, soprattutto in ambienti già predisposti a vedere trame nascoste.

Così la macchina diventa l’alleata ideale del sospetto. Non perché confermi la realtà, ma perché sforna contenuti che hanno la giusta consistenza estetica e linguistica per sembrare rivelatori. Una specie di assistente creativo del “forse non ce lo dicono”. E più questi contenuti vengono rilanciati da feed, chat, gruppi chiusi e creator in cerca di engagement, più l’indizio sintetico diventa oggetto sociale prima ancora che informativo.

La vera emergenza è la saturazione

Il punto più inquietante non è nemmeno il singolo falso ben riuscito. È la saturazione del campo informativo. Se tutto può essere prodotto, manipolato, rilanciato e remixato in massa, allora il cittadino medio non smette solo di credere al falso. Rischia di smettere di credere a qualsiasi cosa. E quando tutto diventa incerto, spesso vince chi urla con più sicurezza.

Per questo l’AI può diventare la migliore alleata del complottismo, proprio come mostrano anche i casi di deepfake UFO e di nuova estetica dell’avvistamento: non perché dimostri le tesi più assurde, ma perché erode il terreno comune su cui distinguere tra prova, ipotesi e fiction interessata. È un acceleratore di ambiguità, e l’ambiguità è il carburante più prezioso di ogni narrazione cospirativa.

Perché i social premiano i contenuti complottisti

I social non premiano i contenuti complottisti perché sono segretamente governati dai rettiliani. Li premiano per un motivo molto più banale e molto più serio: perché funzionano benissimo sul mercato dell’attenzione. Scatenano emozione, rabbia, paura, senso di appartenenza, desiderio di condivisione. In altre parole, fanno il lavoro sporco che gli algoritmi amano: tengono la gente incollata.

Le inchieste parlamentari britanniche sul rapporto tra social, disinformazione e algoritmi lo dicono in modo netto: i sistemi di raccomandazione possono creare camere dell’eco, normalizzare contenuti estremi e amplificare materiali dannosi quando questi generano engagement. Non perché siano “veri”, ma perché performano. È la differenza tra una piazza pubblica e un casinò dell’attenzione: nella seconda vince ciò che fa giocare ancora.

Il complottismo è un contenuto perfetto per la piattaforma

Pensaci: un contenuto complottista ha quasi sempre un titolo forte, un nemico chiaro, un colpo di scena, una rivelazione, una promessa implicita di sapere proibito. È il sogno erotico dell’algoritmo. Meglio ancora se il video dura poco, lascia domande aperte e spinge l’utente a cercare il capitolo successivo.

Il punto è lo stesso che abbiamo già visto in perché lo scroll infinito ci fa restare e in perché alcuni contenuti diventano virali: la piattaforma è costruita per ottimizzare permanenza, interazione e ritorno. Se il contenuto complottista offre tutto questo, entra nel circuito preferenziale.

Non serve una cospirazione delle piattaforme. Basta un design che premia l’intensità più della qualità. E i contenuti complottisti sono intensità concentrata. Sono facili da remixare, facili da commentare, facili da trasformare in serie. Ogni post non chiude il discorso: apre un altro pertugio. E ogni pertugio è tempo speso sulla piattaforma.

Dal dubbio sano al rabbit hole automatizzato

Il problema non è vedere un video assurdo. Il problema è vederne uno, poi un altro, poi una reaction, poi il debunking del debunking, poi un creator che “non dice di crederci ma fa domande”, poi cento commenti che trattano l’ipotesi più estrema come se fosse la più coraggiosa. Questo è il rabbit hole.

Secondo diverse ricerche e report regolatori, i feedback loop algoritmici possono rafforzare l’esposizione a contenuti sempre più estremi. A forza di vedere una narrazione, questa smette di sembrare marginale e comincia a sembrare normale. È la pedagogia del feed: non ti convince in un colpo solo, ti abitua. Ti allena a percepire come “aperto” e “indipendente” ciò che in realtà è solo emotivamente più rumoroso.

Qui si incastra anche il meccanismo della prova sociale. Se un video ha milioni di views, commenti a raffica e facce convinte che reagiscono in catena, l’utente medio tende a trattarlo come rilevante. Non perché lo abbia verificato, ma perché lo vede già consacrato dal traffico. È la democrazia deformata del feed: non decide il più fondato, decide il più performante.

La monetizzazione del sospetto è il vero carburante

Qui entra la parte meno romantica. Il complottismo non è solo un prodotto culturale: è anche un prodotto economico. Porta views, iscritti, donazioni, corsi, community, merchandising, identità. Chi produce sospetto continuo costruisce audience molto fedeli, perché vende una cosa più forte dell’intrattenimento: vende accesso a una verità negata. È la logica che ritroviamo anche in QAnon come identità digitale.

In questo senso il complottismo è la forma perfetta di economia delle piattaforme: contenuti a costo basso, intensità alta, fidelizzazione forte. Altro che eccezione. È quasi un modello di business. E più il sistema fatica a distinguere tra qualità informativa e resa statistica, più questi contenuti continueranno a salire.

Fonti esterne utili:

- Rapporto del Parlamento britannico su social media, misinformation and harmful algorithms

- La review di Ofcom sulla vulnerabilità alla disinformazione.

- Il documento NIST su synthetic content e trasparenza digitale

- C2PA sulle credenziali di provenienza dei contenuti.