Now Reading: La roadmap dell’intelligenza artificiale a inizio 2026

-

01

La roadmap dell’intelligenza artificiale a inizio 2026

La roadmap dell’intelligenza artificiale a inizio 2026

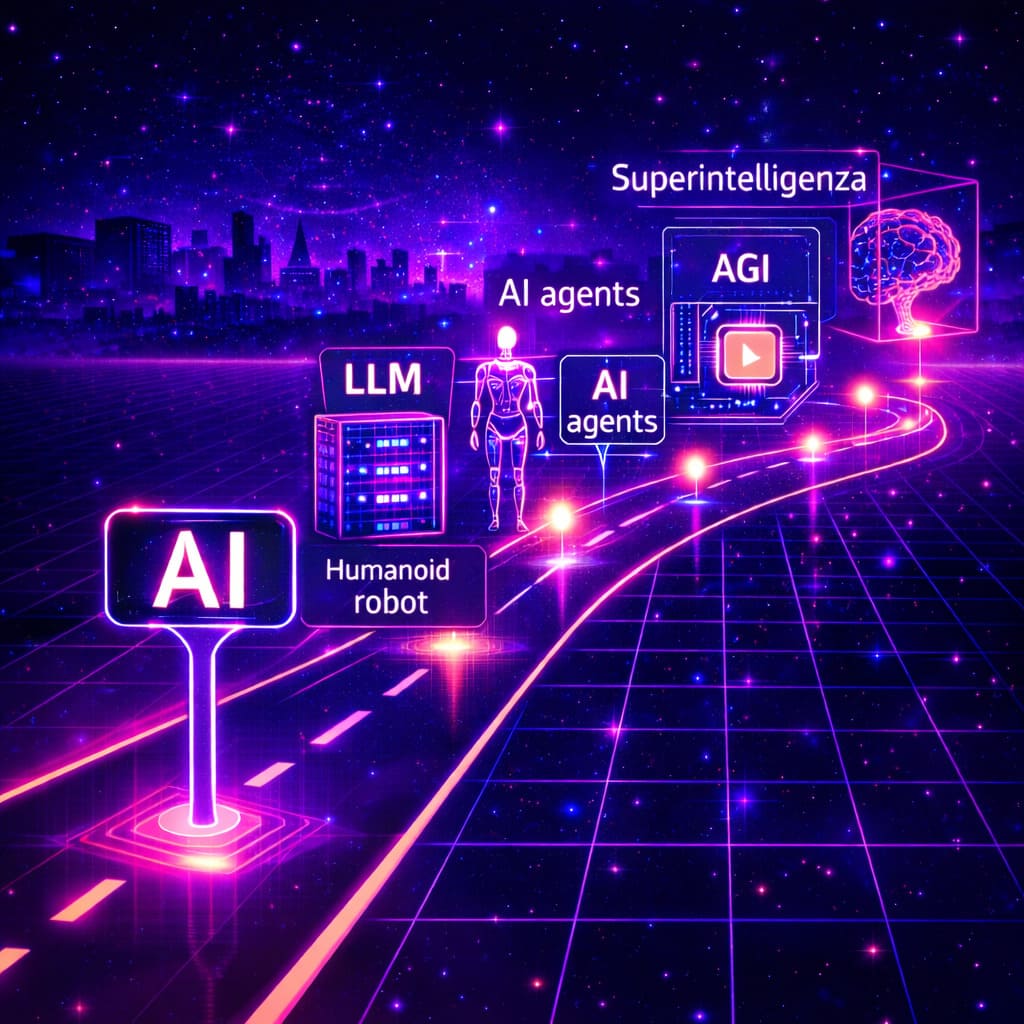

A inizio 2026 la roadmap dell’intelligenza artificiale passa dagli assistenti agli agenti. Ma tra AI, AGI e singolarità ci sono differenze decisive.

All’inizio del 2026 osserviamo un sistema industriale che sta cambiando forma sotto i nostri occhi. Nel giro di pochi anni siamo passati dai chatbot sorprendenti ma limitati a modelli che ragionano meglio, lavorano su contesti molto più lunghi, usano strumenti esterni e iniziano a funzionare come agenti. Il punto non è soltanto che l’AI sta migliorando. Il punto è come sta migliorando: meno demo isolate, più infrastruttura, più automazione, più integrazione dentro software, lavoro e decisioni.

Per capire la roadmap a inizio 2026 bisogna distinguere tre livelli. Il primo è l’AI attuale: sistemi sempre più multimodali, agentici e specializzati, già capaci di produrre valore economico. Il secondo è l’AGI, cioè l’idea di un’intelligenza generale capace di eguagliare o superare l’essere umano nella maggior parte dei compiti cognitivi. Il terzo è la singolarità, concetto ancora più radicale e speculativo, che immagina una fase di auto-miglioramento rapidissimo e fuori scala. Questi tre piani vengono spesso confusi, ma non sono la stessa cosa. E oggi il rischio principale è proprio questo: scambiare il salto da chatbot a agenti per la prova che siamo già sulla soglia della singolarità.

La vera roadmap dell’AI nel 2026: da modello a sistema operativo del lavoro

Il trend più concreto a inizio 2026 è chiaro: l’AI sta diventando meno “assistente che risponde” e più “sistema che esegue”. OpenAI definisce gli agenti come sistemi che portano avanti compiti in autonomia usando modelli linguistici, strumenti e guardrail. Anthropic, nel suo report di gennaio 2026 sull’agentic coding, descrive un passaggio da task che durano minuti a flussi di lavoro che possono durare giorni, con coordinamento tra più agenti. Anche Google spinge nella stessa direzione: con Gemini 3 parla apertamente di un modello pensato per ragionare meglio, usare strumenti e muoversi dentro prodotti, sviluppo software e pianificazione.

Tradotto in linguaggio meno pubblicitario: ad oggi la roadmap AI è una filiera composta da sei passaggi molto concreti.

Primo: modelli più forti nel ragionamento. Non basta più generare testo fluido: conta la capacità di scomporre problemi, recuperare informazioni e mantenere coerenza su contesti lunghi. L’aggiornamento Claude Opus 4.6, per esempio, insiste proprio su pianificazione, task agentici più lunghi e contesto fino a un milione di token in beta.

Secondo: multimodalità nativa. Testo, immagini, audio, video e interfacce non sono più moduli separati, ma pezzi dello stesso sistema. Questo rende l’AI più utile nel mondo reale, perché il mondo reale non è fatto di puro testo.

Terzo: memoria, contesto e recupero di informazioni. Il valore dei nuovi sistemi cresce quando riescono a tenere insieme basi documentali, tool esterni, cronologia operativa e vincoli aziendali.

Quarto: tool use e agency. L’AI non si limita a suggerire; apre documenti, interroga database, compila codice, controlla risultati, corregge errori e decide quando chiedere conferma. È qui che l’AI inizia ad assomigliare più a un collaboratore che a una barra di ricerca raffinata.

Quinto: integrazione verticale. I modelli da soli valgono meno delle piattaforme che li inseriscono in flussi di lavoro, suite cloud, motori di ricerca, software enterprise, customer support, ricerca scientifica e automazione dello sviluppo.

Sesto: governance. Dal 2025 le regole europee sui modelli general purpose sono entrate nella fase applicativa, e dal 2 agosto 2026 scatteranno i poteri di enforcement della Commissione sui provider di GPAI. Significa che la roadmap non è solo tecnica: è industriale, geopolitica e normativa.

In altre parole, il 2026 somiglia molto più all’inizio di una fase di industrializzazione dell’intelligenza artificiale che a un film di fantascienza già compiuto. Lo dimostra anche lo Stanford AI Index 2025: investimenti privati, adozione aziendale e uso della generative AI sono cresciuti con forza, segno che il settore si sta muovendo da ondata sperimentale a infrastruttura economica.

AGI: obiettivo reale, parola ombrello o mito di marketing?

L’AGI rimane il punto più ambiguo del discorso. Tutti ne parlano, ma quasi nessuno la definisce allo stesso modo. OpenAI continua a usare una definizione molto ampia: sistemi generalmente più intelligenti degli esseri umani. Google DeepMind parla di AI capace almeno quanto gli umani nella maggior parte dei compiti cognitivi e sostiene che potrebbe arrivare “nei prossimi anni”. Anthropic, in un documento inviato all’OSTP statunitense nel marzo 2025, ha scritto di aspettarsi sistemi molto potenti tra fine 2026 e inizio 2027.

Queste dichiarazioni sono importanti perché arrivano dai laboratori di frontiera. Ma non equivalgono a una prova. Sono segnali strategici, non certificati storici dal futuro. L’AGI è ancora una meta mobile: ogni volta che l’AI conquista una nuova capacità, la linea viene spostata in avanti. Se un modello scrive codice, diciamo che non basta. Se ragiona bene sui benchmark, diciamo che non capisce davvero. Se usa strumenti, diciamo che non ha autonomia generale. È il classico effetto del bersaglio che arretra.

Per questo, a inizio 2026, la domanda utile non è “l’AGI è arrivata?”. La domanda utile è: quali funzioni umane stanno diventando economicamente automatizzabili prima di una AGI piena? Ed è qui che la questione diventa davvero seria. Perché non serve una AGI perfetta per trasformare radicalmente il lavoro cognitivo. Basta un’AI abbastanza affidabile da automatizzare una quota crescente di ricerca, coding, analisi, customer care, documentazione, pianificazione e coordinamento.

Le stime pubbliche restano molto divergenti. Una sintesi di 80,000 Hours sui forecast aggiornata a febbraio 2026 riporta che il mercato predittivo di Metaculus assegna circa il 25% di probabilità all’AGI entro il 2029 e il 50% entro il 2033, ma lo stesso articolo avverte che la definizione usata è imperfetta e che questi numeri vanno letti con cautela. Questo è il punto: il consenso non esiste. Esiste invece una compressione dei tempi percepiti, dovuta al ritmo con cui stanno migliorando ragionamento, agency e integrazione.

Singolarità: il grande racconto che corre più veloce dei fatti

La singolarità è un concetto ancora diverso. Non indica semplicemente l’arrivo di un’AI molto brava, ma un punto in cui le macchine iniziano a migliorarsi da sole così rapidamente da rendere il cambiamento quasi incontrollabile o incomprensibile per gli esseri umani. È l’idea resa popolare da Ray Kurzweil e da buona parte dell’immaginario techno-accelerazionista.

Il problema è che tra l’AI reale del 2026 e la singolarità c’è ancora un abisso. Oggi vediamo progressi rapidi, sì, ma vediamo anche colli di bottiglia evidenti: costi energetici, limiti di affidabilità, dipendenza dai dati, fragilità nel mondo fisico, difficoltà di verifica, sicurezza, allineamento e governance. Persino i laboratori più aggressivi nel parlare di AGI affiancano alla corsa sulle capacità una crescita visibile del linguaggio sulla sicurezza. Google DeepMind insiste su risk assessment e readiness. Anthropic pubblica report di rischio periodici. OpenAI discute apertamente problemi come lo scheming e la necessità di guardrail per gli agenti.

Questo non significa che la singolarità sia impossibile. Significa che, a inizio 2026, è molto più una cornice narrativa che una tappa misurabile della roadmap. Serve a orientare aspettative, investimenti e immaginazione, ma non descrive ancora uno stato verificabile del mondo. La differenza è enorme: una roadmap seria ha milestone osservabili; la singolarità, oggi, resta soprattutto un’ipotesi sul comportamento futuro di sistemi che non esistono ancora in forma piena.

La vera traiettoria 2026-2030: potere, infrastruttura, dipendenza

Se togliamo un attimo il rumore della propaganda tecnologica, la roadmap dell’AI appare più nitida. Da qui ai prossimi anni vedremo probabilmente:

- agenti più affidabili su compiti lunghi e multi-step;

- modelli integrati in ogni grande suite software e piattaforma cloud;

- maggiore automazione del lavoro cognitivo ripetibile;

- competizione feroce su chip, data center, energia e dataset;

- più pressione regolatoria su trasparenza, copyright, sicurezza e uso dei modelli general purpose;

- una nuova divisione tra chi usa l’AI come leva di produttività e chi la subisce come infrastruttura esterna.

La vera roadmap, quindi, non va letta solo come una sequenza tecnica che porta da AI ad AGI e poi forse alla singolarità. Va letta come una progressiva concentrazione di potere. Chi controlla modelli, computer, distribuzione e interfacce controlla sempre di più il modo in cui lavoriamo, impariamo, produciamo contenuti e prendiamo decisioni. L’AGI, in questo quadro, rischia di funzionare anche come parola-faro: attira capitali, giustifica investimenti enormi e costruisce l’idea che il futuro appartenga inevitabilmente a chi corre più veloce.

Ma inevitabile non è la parola giusta. Il 2026 non è l’anno in cui possiamo dichiarare vinta la corsa verso l’AGI, né tantomeno entrati nella singolarità. È l’anno in cui dobbiamo capire che l’AI sta già ridisegnando il presente prima ancora di aver raggiunto il suo mito finale.

In conclusione AI, AGI e singolarità sono tre livelli diversi; il primo sta già cambiando il mondo, il secondo è una soglia incerta, il terzo resta per ora una narrativa fantascientifica.

Approfondimenti interni

- Cos’è davvero l’intelligenza artificiale

- Cos’è l’AGI

- I limiti dell’intelligenza artificiale

- L’AI cambierà internet?