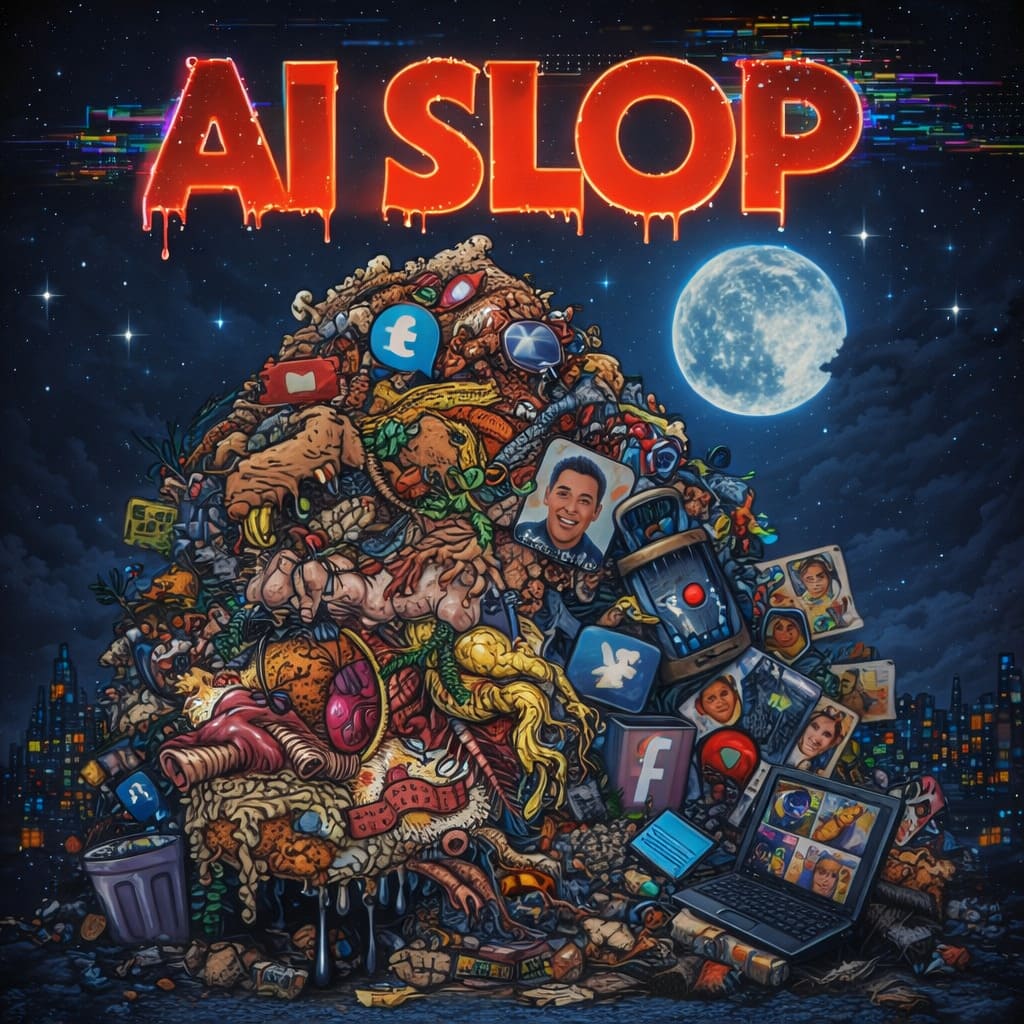

Now Reading: AI slop: le Big Tech vogliono davvero fermarlo?

-

01

AI slop: le Big Tech vogliono davvero fermarlo?

AI slop: le Big Tech vogliono davvero fermarlo?

Le Big Tech dicono di voler fermare l’AI slop, ma continuano a produrlo. Ecco perché il problema è nel modello di business, non nella tecnologia.

L’intelligenza artificiale sta riempiendo internet di contenuti. Immagini, video, testi, volti che non esistono. Tutto sembra reale, ma non lo è. E mentre il problema cresce, le aziende che lo hanno creato dicono di volerlo risolvere.

Ma c’è un dettaglio che non torna: sono le stesse aziende che continuano ad alimentarlo.

Il problema non è l’AI, è l’incentivo

Le piattaforme parlano sempre più spesso di “autenticità”. Dicono che le persone vogliono contenuti reali, affidabili, verificabili. E così nascono soluzioni come C2PA: sistemi che dovrebbero certificare l’origine dei contenuti, distinguere ciò che è umano da ciò che è generato.

Sulla carta, ha senso. Nella realtà, no.

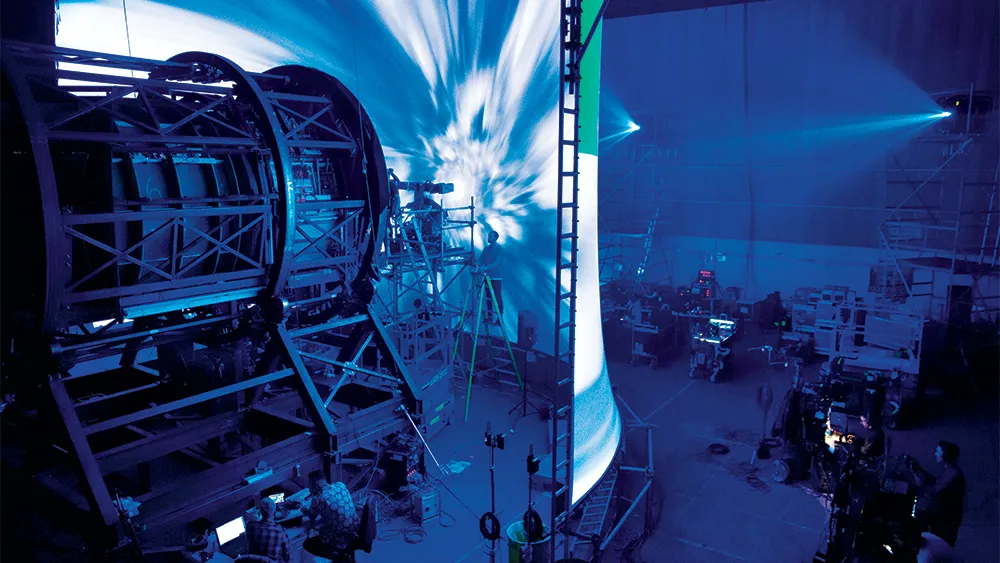

Perché mentre sviluppano strumenti per “etichettare” i contenuti AI, le stesse aziende stanno costruendo macchine sempre più potenti per generarli. Più veloci, più economiche, più realistiche.

È come cercare di svuotare una vasca lasciando il rubinetto aperto.

E quel rubinetto non è un errore: è il modello di business.

I contenuti generati funzionano. Tengono le persone incollate allo schermo. Producono engagement. Riempiono i feed. Alimentano pubblicità, abbonamenti, tempo di permanenza.

In altre parole: fanno guadagnare.

L’illusione del controllo

Strumenti come C2PA non nascono per fermare davvero il problema, ma per gestirne la percezione.

Ti danno l’idea che esista un sistema di controllo. Che qualcuno stia “certificando” la realtà. Che ci sia una distinzione chiara tra vero e falso.

Ma non è così.

Funzionano solo se tutti partecipano. Chi crea contenuti, chi li modifica, chi li distribuisce. Basta un anello fuori dal sistema — ed è tutto inutile.

E poi c’è un problema ancora più semplice: nessuno controlla davvero.

Le etichette sono nascoste, difficili da trovare, spesso incoerenti. A volte non compaiono nemmeno. Per verificare un contenuto, dovresti cercare metadati invisibili o usare strumenti esterni.

Nella pratica, non lo fa nessuno.

E quindi il sistema esiste, ma non serve.

La realtà è diventata un formato

L’AI non sta solo copiando la realtà. Sta imparando a replicarne le imperfezioni.

Grana, errori, movimenti sporchi, estetica “raw”. Tutto ciò che prima segnalava autenticità oggi è simulabile.

I creator provano a differenziarsi tornando al “vero”. Ma anche quello diventa uno stile replicabile.

A questo punto, il problema non è più distinguere il falso dal vero. Il problema è che il vero non è più riconoscibile.

E quando succede, cambia tutto.

Cambia il valore dei contenuti. Cambia la fiducia. Cambia il modo in cui percepiamo ciò che vediamo.

Il conflitto che nessuno vuole risolvere

Le Big Tech dicono di voler proteggere gli utenti dalla disinformazione, dai deepfake, dai contenuti ingannevoli.

Ma allo stesso tempo investono miliardi per rendere quei contenuti sempre più convincenti.

Non è una contraddizione. È un equilibrio.

Da una parte costruiscono strumenti di controllo. Dall’altra espandono il problema. Perché fermarlo davvero significherebbe rallentare la crescita, limitare l’uso dell’AI, ridurre i contenuti.

E questo va contro ogni incentivo economico del sistema.

Quindi cosa succede?

Si crea una narrativa: “stiamo lavorando per risolvere il problema”. Ma nel frattempo, il problema diventa il prodotto.

Chi vince davvero

In questo scenario, non vince chi crea contenuti migliori.

Vince chi ne produce di più. Vince chi occupa più spazio nel feed. Vince chi riesce a catturare attenzione, anche solo per pochi secondi.

E l’AI è perfetta per questo.

Abbassa le barriere, aumenta il volume, accelera tutto. Il risultato è un ambiente saturo, un “Horror Pleni” dove la qualità conta sempre meno e la quantità sempre di più.

Un ambiente dove distinguere ciò che vale da ciò che è rumore richiede tempo, energia, attenzione. Ed è proprio questo il punto. Più tempo passi a filtrare, più tempo resti dentro.

La vera domanda

Le Big Tech vogliono davvero fermare l’AI slop?

La risposta non sta nelle dichiarazioni, ma negli incentivi. E gli incentivi dicono altro. Un sistema costruito sull’attenzione non ha interesse a ridurre il rumore. Ha interesse a moltiplicarlo.

Perché più contenuti significano più possibilità di catturarti. Anche se quei contenuti non sono reali. Anche se non servono. Anche se rendono tutto più confuso.

Alla fine, il problema non è se l’AI sta rovinando internet. Il problema è che, per chi lo gestisce, sta funzionando perfettamente.