Now Reading: Effetti visivi AI: come stanno cambiando la post-produzione

-

01

Effetti visivi AI: come stanno cambiando la post-produzione

Effetti visivi AI: come stanno cambiando la post-produzione

Effetti visivi AI: come l’intelligenza artificiale entra nella post-produzione tra rotoscoping, compositing, cleanup, previs e nuovi limiti creativi.

Gli effetti visivi sono uno dei terreni in cui l’intelligenza artificiale smette di sembrare fantascienza e diventa subito infrastruttura. Non serve immaginare il regista che chiede a una macchina di “fare un film”. Basta guardare la post-produzione di oggi: selezione automatica dei soggetti, tracciamento, pulizia degli sfondi, estensione di clip, ricostruzione di dettagli, compositing assistito, upscaling, depth map, motion analysis. Qui l’AI non arriva come promessa astratta. Arriva come riduzione di tempo e fatica nei passaggi più costosi.

Adobe lo mostra bene con strumenti come Roto Brush in After Effects e Content-Aware Fill, che velocizzano isolamento dei soggetti e rimozione di elementi indesiderati. Blackmagic fa lo stesso nella famiglia DaVinci Resolve, dove il Neural Engine supporta riconoscimento facciale, object detection, smart reframing e maschere assistite. Autodesk, con Flow Studio, spinge ancora di più sulla trasformazione del girato in scene 3D editabili.

Dove l’AI sta già cambiando i VFX

Il primo cambiamento è semplice: l’AI automatizza compiti che prima consumavano ore di lavoro altamente tecnico. Il rotoscoping, ad esempio, è da sempre uno dei lavori meno visibili ma più pesanti della filiera VFX. Se un sistema riesce a isolare una persona, seguirne i contorni e mantenere una maschera coerente nel tempo, libera energie preziose per il lavoro artistico vero e proprio.

Lo stesso vale per clean-up, tracking, ricostruzione di parti mancanti, relighting assistito, segmentazione di soggetti, gestione di profondità e prep dei materiali. In pratica l’AI comprime il lavoro preparatorio. E quando il lavoro preparatorio si comprime, cambia l’economia dell’intero reparto. Piccoli team possono tentare operazioni che prima richiedevano strutture più pesanti. Studi più grandi possono spostare risorse verso shot più complessi o accorciare i cicli di revisione.

È per questo che gli effetti visivi AI non sono una questione laterale. Tocccano il cuore del rapporto tra tecnica e scala produttiva. E si collegano direttamente a ciò che già avviene in AI per effetti speciali e AI per il montaggio video, dove la stessa logica di assistenza e automazione si estende ad altre fasi della catena.

Il vantaggio non è solo il risparmio

Ridurre costi e tempi è importante, ma non è l’unico vantaggio. L’AI rende più facile iterare. Un regista può testare alternative visive in modo più rapido, un supervisor può far circolare versioni provvisorie più leggibili, un team può verificare prima se un’idea funziona davvero. In altre parole, l’AI non serve solo a fare le stesse cose più in fretta. Serve anche a provare più cose senza esplodere il budget.

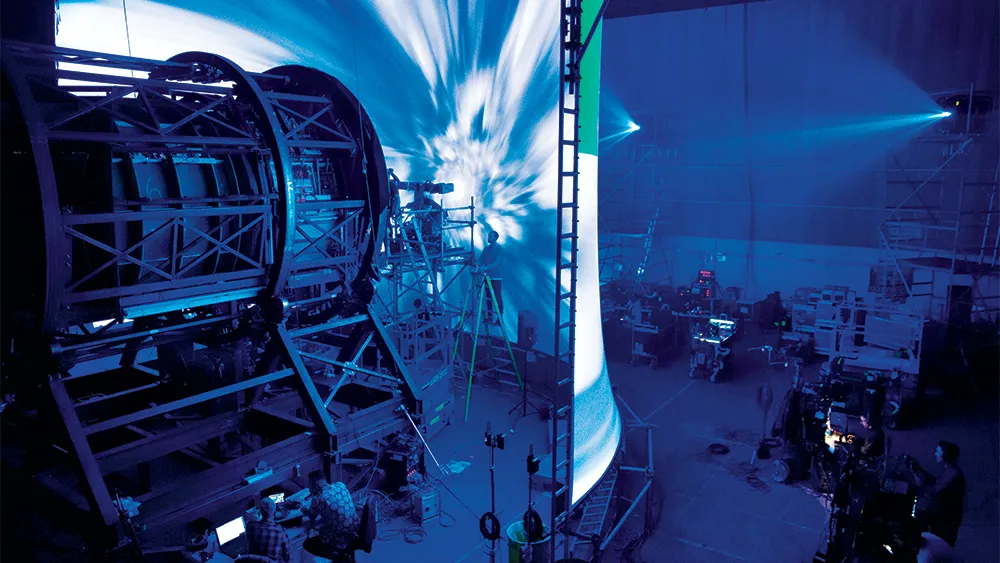

Questo ha un effetto culturale importante: sposta i VFX da reparto di correzione tardiva a spazio di progettazione anticipata. Quando puoi simulare meglio una scena prima di chiuderla, cambia anche il modo in cui la pensi. La previsualizzazione, la costruzione di mondi virtuali e il compositing non restano confinati alla coda del processo, ma iniziano a dialogare prima con scrittura, regia e montaggio.

Non a caso il tema si intreccia con quanto già si vede nell’uso di strumenti real time e nel rapporto sempre più stretto tra cinema e ambienti digitali, come nel caso di game engine usati nel cinema. Il film non è più soltanto qualcosa che si gira e poi si rifinisce. Diventa un oggetto che si prepara, si simula, si corregge e si ricostruisce in ambienti computazionali sempre più centrali.

Dove finiscono i vantaggi e iniziano i problemi

Il rischio più grande è raccontare l’AI come bacchetta magica. In realtà gli effetti visivi continuano a dipendere da occhio, gusto, pipeline, supervisione e qualità dei dati in ingresso. Un matte sbagliato, un tracking incoerente o una ricostruzione sintetica troppo visibile non fanno risparmiare tempo: lo bruciano. L’automazione accelera solo quando è governata bene.

Nuove competenze, non solo nuovi plugin

Quando una parte del lavoro si automatizza, il valore non scompare: si sposta. Nel caso dei VFX il professionista conta sempre meno per la capacità di eseguire all’infinito una mansione isolata e sempre di più per la capacità di supervisionare qualità, coerenza, integrazione e pipeline. Bisogna capire cosa delegare, come validare l’output, quando rifare manualmente e come mantenere una continuità estetica tra elementi reali e sintetici.

Questo vale soprattutto nei team piccoli, dove l’AI può sembrare una scorciatoia totale. In realtà è un acceleratore che richiede più consapevolezza, non meno. Se manca la supervisione, i difetti si propagano più in fretta di prima. Se la supervisione c’è, allora l’automazione può davvero liberare spazio per decisioni migliori.

È anche per questo che il confine tra artista VFX, tecnico di pipeline e regista creativo tende a farsi più poroso. Chi lavora bene con questi strumenti non si limita a “fare l’effetto”. Costruisce il modo in cui l’effetto entra nel linguaggio del film.

C’è poi la questione della responsabilità creativa. Se il software propone sempre la soluzione più pulita, più credibile, più “corretta”, il rischio è perdere quella parte di scelta umana che rende un’immagine davvero significativa. I VFX non servono solo a nascondere il trucco. Servono anche a costruire una visione. E una visione non si misura con la sola efficienza.

Infine torna il nodo dei diritti e della provenienza dei modelli. Quando un tool generativo entra in pipeline commerciali, la domanda su training data, utilizzo permesso e tracciabilità non può essere rimossa. Per i reparti VFX questo significa che la tecnica, da sola, non basta più. Serve anche un controllo giuridico e produttivo più severo.

Cosa cambia per il cinema

Nel medio periodo il cambiamento più serio non sarà l’esplosione di effetti spettacolari. Sarà l’abbassamento della soglia d’accesso. Più case di produzione, più creator, più team indipendenti potranno tentare lavorazioni che prima erano economicamente fuori scala. Questo può essere una grande apertura. Ma può anche spingere il mercato verso un eccesso di immagini facili, lisce, iper-controllate, tutte un po’ simili.

Per questo la questione non è se l’AI renderà i VFX più veloci. Lo farà. La questione è se questa velocità servirà a liberare immaginazione o a standardizzare l’immaginabile. In un ecosistema dominato da piattaforme, dati e ottimizzazione, non è una differenza secondaria.

Perché questo riguarda anche chi guarda film senza occuparsi di tecnica

Potrebbe sembrare un tema da addetti ai lavori, ma non lo è. Se i VFX diventano più economici e più facili da iterare, cambierà anche il tipo di immagini che invaderanno il mercato. Più possibilità di correzione e potenziamento significano più film, serie e contenuti in cui la manipolazione visiva è presente anche quando non viene percepita come “effetto”.

In pratica l’AI può rendere il visibile più malleabile senza renderlo per forza più sorprendente. È una differenza importante. Lo shock dell’immagine spettacolare potrebbe diminuire, proprio mentre cresce la quota di artificio invisibile dentro ciò che guardiamo ogni giorno.

Negli effetti visivi l’AI non sta arrivando, è già entrata. Il punto non è impedirle di lavorare. Il punto è evitare che la sua efficienza diventi il criterio con cui decidiamo anche che cosa vale la pena vedere.